今日の新作アセット

- VR Watson Speech Sandbox

- VRの没入感をさらにアップさせる為のスペシャル機能!

- 声を発して音声認識させるスピーチサンドボックスのサンプルシーン

- 無料 【リリース日】2018年3月15日(新作アセット)

- Lexicon

- Watsonを活用したAR、VR、MRの高度な音声入力ツールキット

- Oculus Rift、HoloLens、iPhone X、およびPixel 2で動作します

- $80.60 => $54.00 33%OFF 【開催期間】2018年3月15日〜不明

- IBM Watson Unity SDK

- Watsonは画像認識、音声変換、文字で会話のできる賢いAI。UnityでWatsonが使えるようになるSDKです。

- 無料 【リリース日】2018年1月18日

- Watsonは画像認識、音声変換、文字で会話のできる賢いAI。UnityでWatsonが使えるようになるSDKです。

初めての方はアカウント作成を!

これまでのIBM Cloudアカウントは、初月無料でそれ以降は有料のイメージでしたが、

『クレジットカード登録不要』『期間無制限で使えるLiteプラン』が登場しました!

出典:IBM Cloudライト・アカウント (Bluemix) - Japan

多数のAPIを無制限で使えて無料!

評価利用で軽くさわるだけじゃなく、本番環境としても使えちゃうのがすごい!

前回の記事で作った30日間トライアルアカウントはもう使えなくて困ってましたが、

これからも継続して使えるのは本当にありがたい!

さっそくアカウントを作りました。

アカウントを作り直した話

公式サイトによると、

『30日フリートライアルに登録したメールアドレスの場合は再登録できません。別のメールアドレスを使用して下さい』とのこと。

2018年1月23日に作ったアカウントは無料期間が終わっていたので、

別のメールアドレスで作成してみたら、

「このデバイスからの登録は多すぎます!」

過去に1アカウントしか作成してないのに多すぎると怒られてしまいました。

他のPCでアカウントを作るのが面倒な状況だったので、

手元にあったスマホで登録してみたら無事に作る事ができました。

認証確認のメールが届き、

そのURLを「怒られたPC」で開いたらNGになることもなく、

登録完了の画面が開いて無事にアカウントが作れました。

ライトアカウント利用時には、組織の作成画面で「米国南部」を選択するそうです。

ログインしたら既に設定されてました。

完成プロジェクト/チュートリアル

無料 【リリース日】2018年3月15日(新作アセット)

VR(Oculus Riftやvive)の没入感をさらにアップさせる為のスペシャル機能!

声を発して音声認識させるスピーチサンドボックスのサンプルシーンです。

声で「Create xxxxx」と喋れば、箱やネコ、ケーキや家電製品などオブジェクトが目の前に生成されるサンプルです。

※このチュートリアルを実行するには「VRデバイス(Oculus Riftやvive)」が必要です。

VR Speech Sandbox: Enabling a speech interface within VR - YouTube(1:13)

セットアップ方法

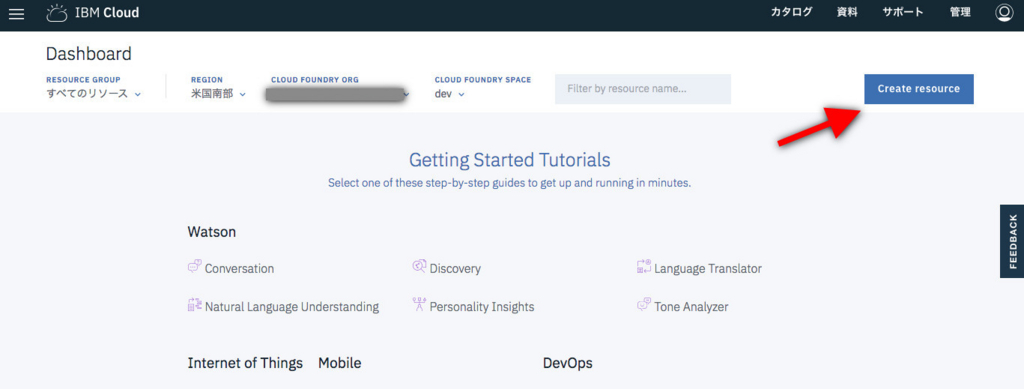

ダッシュボードを開いた状態で、右上の「Create resource」を選択します。

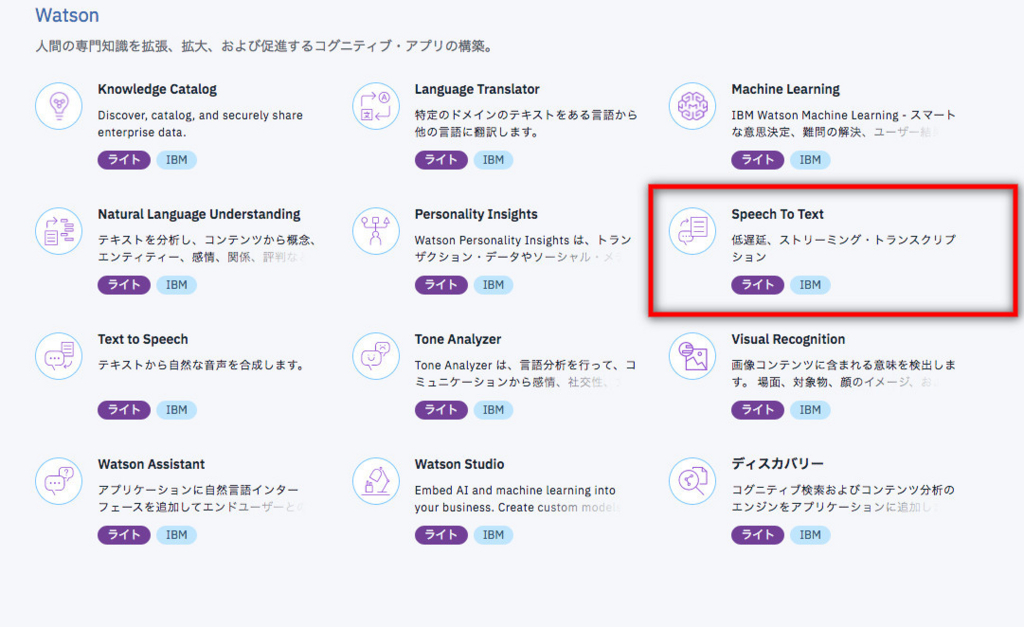

利用可能なAPIメニュー

ライトプランでも全部使えちゃいます!

Watsonの「Speech To Text」からプロジェクトを作成しましょう。

Speech To Textをはじめる

管理→Demoを選択します。

チュートリアル動画だとLunchボタンがありますが、私の環境では表示されず。

プランが関係しているのか不明ですが、良く分からなかった。

動画では↑Lanch toolが管理にあるが、見当たらない。

手順が間違っている可能性あり。

音声認識(デモ)をやってみた

https://speech-to-text-demo.ng.bluemix.net/

↑アカウント持ってない人でも試せるかも?

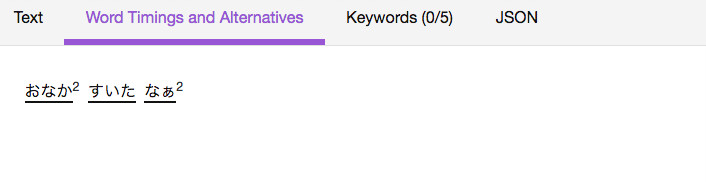

ブラウザからマイクを通してリアルタイム音声翻訳や、音声ファイルをアップロードして音声認識することが出来るようになっています。

ブラウザでは上手くいかなかったので、「こんにちは」の音声ファイルをアップロード(mp3やwavに対応)

すると音声認識されてテキストで出力されます!

ハッキリと喋るとほぼ完璧。

「お腹すいたなぁ」を試してみた結果画面。

少し長い言葉だったら単語毎に区切られるみたい。

マウスカーソルを「おなか」に持って行くと、日本語にしっかり対応しているのか、

漢字で「お腹」と表示する高機能!

リアルタイム録音は、何が表示されるか分からないワクワク感が楽しい。

これは某ゲーム実況者の声を録音した内容です。

複数人が喋っていて、それをSpeaker 0と1で分けているみたい。結構凄いかも。

ちゃんとしたマイクで試せばもっと精度が高くなると思いますし、次触るときには環境をしっかり整えてテストしたいと思います。

上手く使えば「なまり言葉など方言」の分析に使えるかも?

ワークスペースをUnityとリンクさせる

サービス管理情報から、新規資格情報からUnityとリンクさせるための情報を作ります。

ここで生成された「キー名」「username」「password」は、

Unityにインポートしたソースコード「ExampleTextToSpeech.cs 」にIDをセットします。

参考

強火で進めさんの情報が参考になります。

IBM の Watson を Unity から使う方法 - 強火で進め

セットアップ動画

Voice Commands in VR with Watson - YouTube(7:57)

サンプル画像

アセット説明(機械翻訳)

Unity 5.6.5以降のバージョンが必要

音声コマンドと音声認識を仮想現実体験に統合する方法を示すサンプルアプリケーションです。

使用するには:

1. Models.zipフォルダを解凍します。

2. Blenderをインストールする

3.次の項目を選択して、3つのシーンをそれぞれ順番にロードします。

_Scenes-> MainGame-> MainMenu

_Scenes-> MainGame->チュートリアル

_Scenes-> MainGame-> Sandboxを開き、File-> BuildSettings-> Open Sceneを追加してください

(Oculus Rift用にビルドする場合は、ファイル→ビルドセット→PlayerSettings→バーチャルリアリティSDK→Oculusを追加してください)

4. IBM Watson Speechをテキストおよび会話資格情報に加え、会話IDをScripts-> SpeechSandboxStreaming.csに追加します

詳細な手順については、https://github.com/IBM/vr-speech-sandbox-viveを参照してください。

(注目)正しくセットアップするには手順があります。

zipファイルの解凍、Blenderのインストール、サンプルシーンを順に開くなど、

アセット説明の手順通りに行いましょう。

パブリッシャーのアセット(記録用)

スクリプト/AI

$80.60 => $54.00 33%OFF 【開催期間】2018年3月15日〜不明

IBM Watsonの人工知能を活用したアセットが作家さんからついに登場!

Oculus Rift、HoloLens、iPhone X、およびPixel 2で動作する、AR、VR、MRの高度な音声入力のツールキットです。

手入力ではなく声でコマンド(〇〇を作る。〇〇を置く)が呼び出せるから没入感アップ!

Mixspace Lexiconは、XRの高度な音声入力のためのツールキットです。 Lexiconを使用すると、IBM Watsonを使用して、高度な音声インターフェースをUnityエディターで直接デザインすることができます。 スピーチ入力はタイムスタンプで他の入力(例えば注視とコントローラー)と揃えられているので、フォーカスを急速に変化させながらコマンドを実行することができます。

サンプルシーンには、チェスを操作したり、VRサンプル、HoloLensサンプルが含まれています。

Lexicon Intro - YouTube(5:31)

セール情報

33% off during the early adopter phase! For more info read the blog post.

初期導入段階で33%オフ! 詳細については、ブログの記事を読んでください。

Lexicon Intro HoloLens - YouTube(2:45)

Lexicon ARKit - YouTube(2:28)

Lexicon Samples - YouTube(5:29)

サンプル画像

画像5枚 10秒で一周します。

アセット説明(機械翻訳)

Unity 2017.1.1以降のバージョンが必要

初期導入段階で33%オフ! 詳細については、ブログの記事を読んでください。

Mixspace Lexiconは、XRの高度な音声入力のためのツールキットです。 Lexiconを使用すると、IBM Watsonを使用して、高度な音声インターフェースをUnityエディターで直接デザインすることができます。 スピーチ入力はタイムスタンプで他の入力(例えば注視とコントローラー)と揃えられているので、フォーカスを急速に変化させながらコマンドを実行することができます。

レキシコンはインターネット接続とマイクアクセスが可能なほとんどのプラットフォームで動作するはずです。 このリリースは、Oculus Rift、HoloLens、iPhone X、およびPixel 2でテストされています。

詳細については、当社のマニュアルを参照してください。

サポートに手を携え、XRの音声入力の将来について話し合うために、私たちの余裕のグループに参加してください。 私達はあなたと働くのを楽しみにしています! 私たちのウェブサイトの詳細。

Assetには、エディタスクリプトを含む完全なソースコードが付属しています。

パブリッシャーのアセット(記録用)

2018年1月24日に紹介しましたが一応再掲

スクリプト/AI

無料 【リリース日】2018年1月18日

Watsonは画像認識、音声変換、文字で会話のできる賢いAI。Unityで使えるようになるSDKです。

実用的なアプリはもちろんのこと、シーマンやSiriをもっと発展させた次世代ゲームへの利用価値が高く、流行のAIが一般的に活用できるようになったステキなSDKです。

体験記事

2018年1月24日に新作で登場!チャットボットについて触ってみた編。

2ヶ月前の情報で記事が古いですが、Watsonの基本的な事と、

チャットボットについて触ってみた記事です。

サンプル動画 8つ

Watson Unity SDK: Overview - YouTube(1:10)

Watson Unity SDK: Creating Watson Services - YouTube(2:27)

Watson Unity SDK: Installing the Watson Unity SDK - YouTube(1:53)

Watson Unity SDK: Speech to Text example - YouTube(2:17)

Watson Unity SDK: Setting up the scene for the Language Translator Demo - YouTube(1:27)

Watson Unity SDK: Instantiating Language Translator - YouTube(3:31)

Watson Unity SDK: Make a call to the Language Translator - YouTube(4:24)

Watson Unity SDK: Connecting the Speech to Text example to the Language Translator Demo - YouTube(2:27)

サンプル画像

画像4枚 8秒で一周します。

アセット説明(機械翻訳)

Unity 5.6.5 以降のバージョンが必要Watson Unity SDKを使用すると、Unityで強力なAIを組み込んだアプリケーションを開発することができるようになります。

これで、音声コマンドだけでユーザーがアプリを操作したり、通訳・翻訳サービスを作ったり、画像認識を活用して従来とは別次元に感じるような機能を実装できるようになります。

シンプルな C#スクリプトで構成された Watson Unity SDKを使用するだけで、主要な WatsonのサービスをUnityアプリケーションに直接統合できるだけでなく、初めての認識アプリを開発する方のために Watson Developer Cloudサービスを設定する便利なツールも同梱しています。

SDKで提供される機能

・会話: チャットボットやダイアログツリーを素早く構築

・言語: テキストを分析して非構造化コンテンツからメタデータを抽出

・共感: 口調や人格、感情の状態を認識

・ナレッジ:加速されたデータ最適化機能を使って洞察を得る

・音声: カスタマイズ機能を備えたテキストと音声の変換

セットアップ手順: Github README.md

Watson Unity SDKの使い方のクイックガイドはこちら

詳細情報とコミュニティのヘルプ: developerWorksコミュニティ | Stack Overflowコミュニティ

※ Watsonサービスをインスタンス化してサービスを利用するにはIBM Cloudアカウントへのご登録が必要です。

アカウント登録は無料で、料金はワトソンサービスごとに異なります。

IBM Cloudには、Watsonサービスを構成するための高度なツールもあります。

既に IBM Cloudアカウントをお持ちの場合は、こちらの手順に従ってください。

パブリッシャーのアセット(記録用)

【過去ログ】作者セール&注目アセット